운율 기반 TTS·얼굴 이미지 활용 제로샷 모델 개발

"제한된 데이터 환경서도 안정적인 음성 합성 구현"

에이아이트릭스(대표 김광준)는 세계 최대 규모의 음성·신호처리 학술대회인 'ICASSP 2025(International Conference on Acoustics, Speech and Signal Processing)'에 총 2편의 논문이 채택됐다고 15일 밝혔다. 이번 학회는 지난 6일부터 11일까지 인도 하이데라바드에서 개최됐다.

회사 측은 이번 논문 채택이 음성 인공지능 기술의 고도화 가능성을 보여줬으며, 향후 멀티모달 LLM(Large Language Model)로의 기술 확장을 위한 기반을 마련했다는 점에서 의미가 크다고 강조했다. 특히 의료 현장과 같이 데이터 확보가 제한적인 환경에서도 효율적으로 활용될 수 있다는 점에서 자사 기술력의 응용 확장성이 확인됐다고 밝혔다.

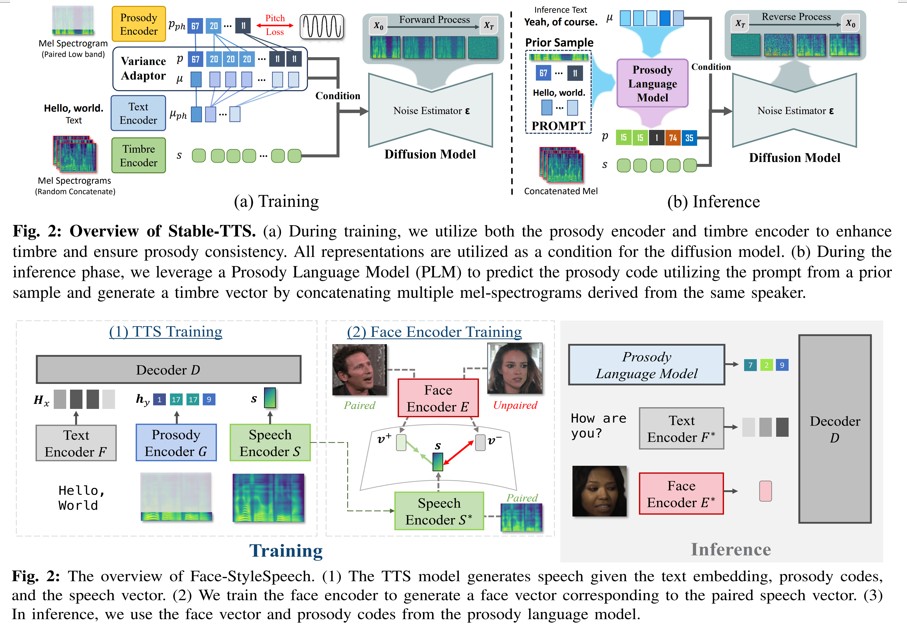

이번 학회에 채택된 논문은 △운율 프롬프팅 기반 화자 적응형 텍스트-음성 합성 모델 'Stable-TTS'와 △얼굴 이미지로부터 음성 특성을 추출해 제로샷 음성합성 성능을 향상시키는 'Face-StyleSpeech'다.

Stable-TTS는 기존 화자 적응형 TTS(text-to-speech) 모델이 겪는 음질 불안정 문제를 개선하기 위한 모델로, 소량의 음성 데이터만으로도 특정 화자의 말투와 억양을 자연스럽게 재현할 수 있다. 회사는 해당 기술이 노이즈 환경에서도 안정적으로 작동한다는 점에서 의료 환경과 같은 현실 조건에서도 유의미한 활용이 가능하다고 설명했다.

Face-StyleSpeech는 얼굴 이미지에서 화자의 스타일 정보를 추출해 운율 정보와 결합함으로써, 기존 대비 자연스러움과 유사도가 향상된 음성 생성을 가능하게 하는 기술이다. 에이아이트릭스는 이 기술이 음성 정보가 부족한 상황에서도 직관적이고 효율적인 응용이 가능하다는 점에서 활용 범위가 넓다고 밝혔다.

에이아이트릭스 한우석 연구원은 "이번 연구는 제한된 데이터만으로도 자연스럽고 안정적인 음성 생성이 가능함을 입증했다. 이는 실제 의료 환경처럼 데이터가 부족한 상황에서도 활용할 수 있을 것으로 기대된다"며 "이번 연구가 텍스트 기반 LLM(Large Language Model)을 넘어서 음성과 이미지를 결합한 멀티 모달 LLM으로 확장하기 위한 발판이라고 생각하며, 앞으로 지속적인 연구 개발을 통해 향상된 사용자 경험과 높은 신뢰도를 갖춘 의료 AI 서비스를 구현하기 위해 노력하겠다"고 전했다.